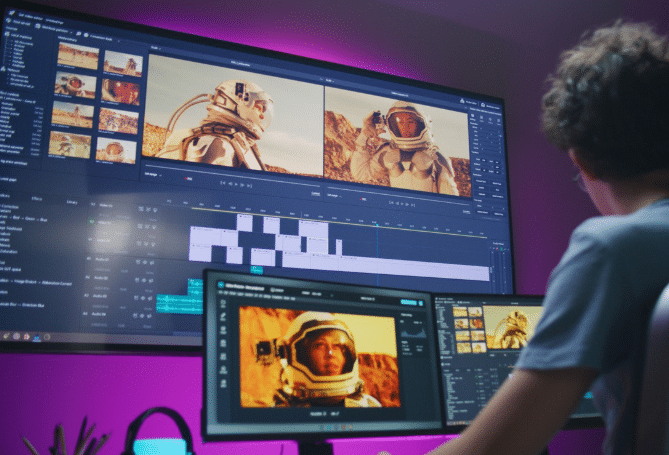

L’univers de la création vidéo par intelligence artificielle connaît une véritable révolution. Longtemps cantonnées à des usages anecdotiques, les IA génératives de vidéo franchissent aujourd’hui un cap technologique impressionnant. Grâce à des modèles récents toujours plus performants, il est désormais possible de générer des vidéos cinématographiques à partir d’un simple texte, d’un fichier audio ou même d’une image statique. Ensemble, ils inaugurent une nouvelle ère pour les créateurs, marques, formateurs et storytellers de tous horizons.

Des acteurs majeurs tels que Meta, OpenAI ou encore des startups innovantes telles que Higgsfield, DreamActor, Argil ou Runway redéfinissent désormais les frontières de la narration visuelle automatisée. C’est pourquoi LabSense vous éclaire sur les IA génératives vidéo les plus puissantes du moment, à travers leur historique, leurs innovations techniques et leurs usages concrets. 🚀

À lire aussi

Génération de vidéo par IA : Les prouesses de Veo 2

« Récemment, c’est le modèle de génération de vidéos par IA Veo 2 développé par Google qui a fait parler de lui : celui-ci redéfinit les standards en matière de production vidéo. Rien de moins ! Ce modèle… » >> Lire la suite

Génération de vidéo par IA : 5 nouveaux modèles qui bouleversent le secteur

« Parmi les innovations les plus marquantes de ces derniers jours, des géants comme Meta, Alibaba et ByteDance dévoilent des technologies révolutionnaires capables de transformer une simple image en séquence… » >> Lire la suite.

Vidéos générées par IA : Sora d’Open AI est arrivé en Europe !

« L’intelligence artificielle continue de repousser les limites de la création numérique, et l’un des exemples les plus frappants reste les prouesses réalisées dans le domaine de la génération de vidéo. » >> Lire la suite.

Meta MoCha : synchronisation parfaite entre voix et animation corporelle

🧪 Des débuts de recherche à la production audiovisuelle

Pour commencer, évoquons le modèle d’un des géants du marché : Meta. MoCha est en effet le fruit des recherches du laboratoire Meta FAIR, avec l’ambition de créer une IA capable de traduire un signal audio en langage corporel expressif. Contrairement à ses prédécesseurs, qui généraient surtout des visages animés statiques, MoCha permet une synchronisation complète du corps et de la voix.

⚙️ Le cœur technologique : diffusion transformer et fusion audio-visuelle

L’architecture repose entre autres sur un Diffusion Transformer avancé, couplé à une attention croisée audio-vidéo. Présentée pour la première fois en 2024 lors d’une conférence, MoCha génère 128 images à 24 images/seconde en 720p à partir d’un fichier audio. Entraînée sur des paires multimodales audio/vidéo/textes, elle est capable de prédire des postures, micro-expressions et mouvements cohérents avec le ton ainsi que le rythme du discours.

🧑💻 Applications : du e-learning aux avatars numériques

MoCha est utilisée pour les avatars numériques réalistes, les assistants virtuels, les formations immersives et les films d’animation IA. Elle facilite d’ailleurs l’intégration d’éléments corporels convaincants dans des vidéos synthétiques sans captation réelle. Son directeur de recherche, Yerzat Dulat, estime qu’il « ne s’agit plus seulement de style. MoCha résout aussi la structure narrative ».

DreamActor-M1 : le nouveau standard des acteurs virtuels ?

🎭 Une IA pensée comme un comédien numérique

De son côté, ByteDance lance tout juste DreamActor-M1 (avril 2025) qui se positionne déjà parmi les meilleurs modèles d’IA générative de vidéo du marché. Véritable acteur numérique, il est capable d’incarner des rôles avec émotion, expressivité et nuance. L’objectif est de produire des séquences dans lesquelles l’avatar joue véritablement, avec des intentions crédibles et des émotions différenciées selon le contexte.

RIP Motion Capture.

— Min Choi (@minchoi) April 3, 2025

China's ByteDance just dropped DreamActor-M1.

This AI turns any image into realistic, full-body human animations 🤯

10 wild examples:

1. Marilyn Monroe comes alive pic.twitter.com/dEL3FkDPSo

🧠 Structure technique : apprentissage profond du comportement humain

Développée par un collectif de chercheurs indépendants et de studios d’effets visuels, DreamActor-M1 repose sur un modèle supervisé entraîné sur des milliers d’heures de vidéos annotées. Il analyse l’affect facial, la gestuelle et les inflexions vocales grâce à des réseaux spécialisés. Son architecture modulaire lui permet d’adapter le jeu selon la scène jouée (pitch, émotion dramatique, explication technique).

💼 Un outil de communication audiovisuelle à la demande

On retrouve DreamActor-M1 dans la formation RH, les cinématiques de jeux vidéo, les vidéos corporate ou encore la présentation de produits à grande échelle. Elle apporte un réalisme narratif auparavant réservé aux tournages physiques et bien plus poussé que les autres IA génératives de vidéo.

Argil : simplicité et performance au service des créateurs

⚡ Une philosophie produit axée sur la vitesse et la fluidité

Argil, jeune pousse française plantée en 2023, mise sur l’accessibilité et la rapidité. L’outil a été pensé pour permettre à n’importe quel utilisateur, sans connaissance en montage ou design, de générer des vidéos riches à partir d’un simple texte. Sa spécialité ? Les avatars vidéo. Intéressant, surtout quand le marché de la génération d’avatars vidéo devrait atteindre 3 milliards de dollars à l’horizon 2032, contre à peine plus d’un demi-milliard à l’heure actuelle.

🖼️ En coulisses : pipelines optimisés pour la narration visuelle

En résumé, la technologie repose sur un système de scénarisation automatique, de génération visuelle par IA et de transitions dynamiques. Argil choisit alors pour l’utilisateur des plans cohérents, une ambiance visuelle harmonisée et des effets professionnels. Pour terminer, le tout fonctionne avec une stack IA propriétaire accélérée via GPU.

🌐 Pitchs, social media, e-commerce… Des utilisations multiples

Parmi les IA génératives de vidéo globalement présentes sur le marché, Argil est prisée pour la création de vidéos sociales, la mise en avant produit, les présentations d’entreprise, et les contenus de marque. C’est pourquoi elle réduit drastiquement le temps de production sans sacrifier la qualité visuelle. Elle s’applique également à n’importe quelle langue.

Runway Gen-4 : l’atout visuel des créateurs digitaux

🎨 Une IA au service de l’esthétique et de l’immersif

Runway Gen-4 est développé par RunwayML, startup américaine pionnière dans l’IA visuelle. Présenté début avril 2025, ce modèle est conçu pour générer des vidéos artistiques et immersives, à partir d’un texte, d’une image ou d’un clip. Il sait faire preuve d’un grand réalisme et a rapidement obtenu la confiance d’investisseurs prestigieux comme Salesforce, Google, et Nvidia. Depuis le modèle précédent, Gen-3 Alpha, la persistance des personnages a également été grandement améliorée, permettant des performances époustouflantes, comme la réalisation de courts-métrages.

🔧 Une technologie de génération d’image animée de pointe

Il repose notamment sur un système avancé de text-to-video et image-to-video, capable de produire des animations avec effets de parallaxe, mouvement fluide, lumière dynamique. Sa technologie repose alors sur un framework de génération multimodale entraîné sur des millions d’échantillons stylisés.

📋 Domaines d’application : de l’art numérique à la narration sociale

Runway Gen-4 est aussi particulièrement utilisé dans la création de contenus YouTube, intros stylisées, NFT animés, ou clips sociaux au rendu cinématique. Il permet de donner vie à des images statiques avec un effet « motion design » immédiat. Par ailleurs, sachez que Gen-4 Image-to-Video est disponible depuis le 31 mars 2025 sur tous les supports payants.

HiggsfieldAI : l’IA qui donne un langage cinématographique à la vidéo générée

🎥 De Snap à la scène : naissance d’un outil narratif puissant

En 2024, HiggsfieldAI est d’abord née de la vision d’Alex Mashrabov, ancien responsable IA chez Snap. Son ambition : dépasser la simple imitation visuelle pour recréer le langage cinématographique. En d’autres termes, Higgsfield ne se contente pas de générer des séquences réalistes, elle structure la narration visuelle en intégrant des mouvements de caméra sophistiqués, des changements de focale et des plans dynamiques.

🎬 Technique et contrôle : une IA pensée comme un réalisateur

Techniquement, l’IA permet de générer des vidéos avec crash zooms, dolly shots, panoramiques 360° et bien plus, le tout à partir d’un prompt. Un moteur de simulation du mouvement permet en effet de fluidifier les transitions et de donner un effet « steadycam » ou « drone » à la demande. Elle repose également sur un pipeline propriétaire d’inférence visuelle, entraîné sur des corpus de vidéos cinématographiques pour apprendre les principes de la mise en scène.

🧩 Des usages variés : clips, storytelling et création sociale

L’adoption est rapide dans les secteurs du clip musical, de la publicité créative et de la création de contenu social. HiggsfieldAI est l’outil rêvé pour les formats courts, narratifs et stylisés qui dominent TikTok et Instagram. Selon son créateur, le but du modèle est de « donner aux créateurs le langage du cinéma, pas juste un style visuel ».

Un tournant décisif pour la création vidéo

Les IA génératives de vidéo entrent dans une nouvelle phase de maturité. Grâce à des innovations issues de la recherche en deep learning, elles permettent de créer des contenus expressifs, visuellement impactants et narrativement structurés, à partir de simples inputs textuels ou audio. Des outils comme Higgsfield, MoCha, DreamActor-M1, Argil ou Runway démocratisent ainsi des compétences autrefois réservées aux professionnels du montage, aux réalisateurs et aux studios d’effets visuels.

💡 Le saviez-vous ?

Les modèles Allready, la solution IA de LabSense, peuvent vous aider à préparer et publier vos vidéos, et même à trouver les meilleurs prompts de génération. Les tester, c’est les adopter !

🤖 Profitez de l’expertise IA de LabSense

Chez LabSense, nous sommes toujours à l’écoute des évolutions du secteur pour intégrer les meilleures technologies IA dans nos solutions de génération de contenu automatisé. En outre, notre expertise de plus de 10 ans, notre plateforme robuste et notre capacité à intégrer vos données métiers (produits, météo, POI, etc.) nous permettent de vous proposer des vidéos et contenus à grande échelle, contextualisés et personnalisés.

📩 Vous souhaitez vous aussi intégrer l’IA dans vos projets ? Contactez notre équipe dès aujourd’hui pour un accompagnement sur mesure !

Et vous ?

*Sondage réalisé avec Allready, la plateforme IA de LabSense